전문적이고 복잡다기한 연구를 ‘단순화’, 연구내용 왜곡과 몰이해

실제 검증서도 문제점 다수, “동일한 맥락의 다른 사안, 구분못해”

“AI봇 요약, 논문 신뢰도를 크게 떨어뜨릴 것” 사실상 금기시

[애플경제 엄정원 기자] 챗GPT가 심층적인 과학 연구에 방해가 될 수도 있다는 지적이 나와 눈길을 끈다. 특히 복잡한 과학 원리와 논리를 간명한 프롬프트를 요구하며 역시 그 수준의 대답으로 ‘단순화’하는 것에 대한 우려가 높다.

이런 우려는 ‘네이처’와 함께 국제적 권위를 지닌 ‘사이언스’저널과 ‘사이언스 프레스 패키지팀’(SciPak)으로부터 제기되어 더욱 관심을 끈다. 국제적인 학술기관과 매체가 AI챗봇의 메커니즘은 과학 발전에 도움이 안 된다고 정식으로 문제를 제기한 셈이다. 이는 문명과 과학발전을 위해 AI를 개발, 그 성능을 끝없이 높여간다는 업계의 대의명분을 무색하게 하는 대목이기도 하다.

복잡한 주제, 단순화한 질문·대답이 문제

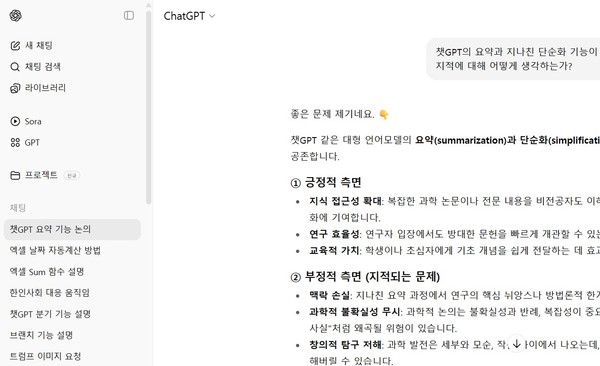

특히 가장 큰 문제는 이미 많은 사용자들도 느끼고 있듯이, 사안의 경중을 불문, 그 전말을 단순화하는 프롬프트와 출력을 선호하는 점이다. 이는 결국 과학발전을 위해 꼭 필요한 ‘깊은 사유’ 혹은 역발상의 엉뚱한 창발적 아이디어를 방해하는 결과를 낳을 수도 있다. 예를 들어 정반합의 변증법적 사고나, 자연에 대한 오해와 이해, 시행착오의 경험 등도 생략되고 만다는 점이다.

문제는 사용자들의 프롬프트에서부터 시작된다. “초등학생처럼 설명해 주세요.”라고 질문을 던지는 사용자들이 많다. 이런 질문이나 이와 유사한 요구는 흔히 소셜 미디어에서 익숙한 모습이다. 그런 방식은 복잡한 주제를 가능한 한 가장 간단한 방식으로 설명하는 AI의 이점을 활영할 때도 써먹곤 한다.

심지어 교육 분야에서도 이런 방식으로 AI가 활용되는 경우가 확산되고 있다. 이에 전문가들은 “챗GPT와 같은 AI 도구에만 의존하여 과학 연구와 논문을 요약해서는 안 된다”고 경고한다.

흔히 연구 논문은 지나치리만큼 복잡하고 전문적인 용어와 언어로 가득 차 있다. 보통의 일반인으로선 해당 논문에 설명된 내용(특히 획기적인 내용)을 이해하기 어렵다. 그렇다보니 과학 저널리스트 등 언론이나 각종 매체 종사자들은 이를 이해하기 쉬운 언어로 요약하기 위해 AI챗봇에 의뢰, 간결한 기사를 작성하곤 한다.

그 때문에 이처럼 챗GPT 등을 사용, 과학 논문을 요약하는 것은 무척이나 위험하고 나쁜 행동이란 지적이 나오고 있다. ‘사이언스’ 저널은 이에 챗GPT 플러스의 경우 과연 간결하게 과학 논문을 요약하면서도 얼마나 더 정확하게 전달할 수 있는지를 검증, 그 결과를 공개해 관심을 끈다.

‘사이언스’ 저널, 검증 결과도 ‘부정적’

검증은 1년 여에 걸쳐 이뤄졌다. 결론적으로 연구팀은 “챗GPT로 생성된 요약은 ‘단순성을 위해 정확성을 희생’하고, ‘과장된 표현을 위해 과다한 편집’을 일삼는다는 사실을 발견했다”고 밝혔다. 즉, 요약에 급급해하다보니, 지나친 단순화로 인해 필요한 세부적 사항이나, 전문적 사안에 대한 정확하고 구체적인 설명이 불가능해진 것이다.

연구팀은 또 “챗GPT 플러스는 ‘획기적인’이라는 단어를 즐겨 사용하곤 한다”고 했다. 이는 과장된 표현을 위해 가장 많이 동원하는 수사이기도 하다. 실제로 사람들이 일상 생활에서 이런 식으로 과장하거나, 주장을 강조하기 위해 즐겨 사용하는 용어나 표현을 챗GPT도 그대로 차용하고 있음이 드러났다.

‘사이언스’ 저널은 이에 “특정 단어들은 AI 챗봇에서 과도하게 사용되는 것으로 악명이 높다보니, 이제는 (많은 사용자들이 이를 따라함으로써) 우리의 일상생활에서 말하는 방식에도 악영향을 미치고 있다”고 우려했다.

검증을 위해 연구팀은 챗GPT 유료 버전을 사용, 매주 두 편의 연구 논문에 대해 세 편의 요약본을 작성하도록 했다. 이렇게 만들어진 요약본에 대해 실제 논문 저자가 평가한 결과는 부정적이었다. 즉 “챗GPT가 전혀 터무니없는 것은 아니지만, 과학 연구나 커뮤니케이션 분야에서 매우 중요한 ‘미묘한 차이’를 파악하는 데는 미흡했다”는 것이다.

그런 검증 결과에 대해 ‘사이언스’ 저널은 또 다른 백서를 통해 “비(非)전문가를 위해 연구 결과를 종합하거나 번역할 수는 없다.”면서 “AI챗봇은 늘 과장하는 경향이 있고, 스스로의 한계점을 제대로 설명하지 못하며, 동일한 맥락에서 두 가지 연구 사안을 논의해야 할 때 이를 제대로 구분하고 이해하지 못한다”고 지적했다.

한 논문 저작자는 백서에서 아예 “챗GPT 요약은 (논문의) 신뢰도를 크게 떨어뜨릴 것”이라고 비판했다. 미국 과학 진흥 협회(AAAS)의 한 회원은 “정보나 세부 사항, 복잡성이 특히 높은 연구의 경우엔 결국 전문 용어로만 접근할 수 밖에 없다”며 사실상 챗GPT에 의한 논문 요약을 금기시하기도 했다.