단기 입력 기억 넘어, 상대자에 대한 장기기억 저장, ‘깊은 대화’

메타 ‘Blenderbot2.0’, Talkie의 ‘Bonds’, 네이버 클로바 케어콜 등

“아직은 모델링 부담으로 초보 수준, 향후 필수적 기술로 부상”

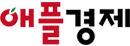

[애플경제 김홍기 기자] 대화 기능을 내세운 챗봇 기술이 발달하면서, 일상의 또 다른 파트너가 되고 있다. 그러나 대부분은 일문일답 식의 프롬프트를 통한 단편적 대화만을 주고 받는 경우가 대부분이다.

최근 국내 최대의 개발자 컨퍼런스인 ‘DEVIEW 2023’에서 흥미로운 내용이 발표되었다. 챗봇의 가장 큰 문제점인 장기기억의 문제였다. 현재 LLM을 사용하는 챗봇은 여러 패턴의 문맥을 이해할 수 있다. 앞 문장들을 포함하여 입력에 넣기 때문이다. 그러나 단기기억은 가능하지만 시간이 오래 지난 일은 잊어버리곤 한다.

최근엔 이른바 대화 상대의 전후 사정과 전에 나눴던 대화를 바탕으로 앞일에 관한 이야기도 나눌 수 있는 이른바 ‘장기기억’ 챗봇 기술이 날로 발달하고 있어 주목된다.

메타는 이미 ‘Blenderbot2.0’을 통해 이를 실현하고 있고, 최근 일상대화 AI 앱으로 인기가 높은 ‘Talkie’도 별도의 ‘Bonds’라는 기능을 통해 상대방에 대한 오래된 기억을 저장, 이를 대화에 써먹고 있다. 국내에서도 네이버 클로바 케어콜이 이들 못지 않은 장기 기억 챗봇으로 인기를 끌고 있다.

“인생 상담 수준의 깊은 대화 가능”

어르신들을 대상으로 단순히 ‘어젯밤의 안부’ 만을 묻는게 아니라, ‘오랫 동안 ○○약을 드셨는데 요즘은 좀 어떠신지’ 하는 식이 건강상태를 물어오는 것이다. 거의 상담 수준이다. 그야말로 웬만한 친지나 자녀보다 더욱 살갑게 다가오는 기계라고 할 수 있다.

물론 기존 챗GPT나 바드 등은 그 동안 대화자와 함께 공유했던 텍스트를 오래 저장하기 위해 노력하고 있으나, 이에 미치지 못하고 있다는 지적이다.

네이버의 클로바 케어콜은 어르신에게 안부전화를 건네며 이상징후를 모니터링하는 서비스입니다. 먼저 대화내용을 요약하여 저장을 합니다. 그리고 다음 번 대화에서 기억한 내용을 활용해서 대답합니다. 예를 들어, 감기기운이 있다고 말하면, 다음 날 감기는 다 나으셨냐고 물어봅니다.

‘Talkie’의 ‘Bonds’는 이런 한계를 뛰어넘는 장기기억 기능을 갖고 있다. 대화를 할때마다 나눈 단어와 문맥을 요약한 문장을 계속 생성하면서, 그 중 기억하고 싶은 것을 선택하는 것이다. 다만 현재는 최대 4개의 문장만 가능하다는게 한계다.

사실 장기기억의 문장들을 모두 입력 프롬프트에 넣는 것은 현재 기술로선 불가능하다는게 전문가들의 지적이다. 챗GPT와 RPA기술을 접목하고 있는 업체인 웤트로닉스의 한 관계자는 “모델의 최대 입력크기가 제한되어 있고 비용도 너무 커진다”면서 “현재는 실시간 질문과 유사한 기억만 비교적 오래 저장한 후 검색 프롬프트에 같이 사용하는 수준”이라고 했다.

‘네이버 클로바 케어콜’이 가장 앞서

이에 비해 네이버 클로바 케어콜은 한층 발전된 기술을 선보이고 있다. 어르신들에게 안부인사를 건네며 이상징후를 모니터링하는 AI 서비스를 출시하고 있다. 이는 네이버의 초거대AI인 하이퍼클로바를 사용한 결과다.

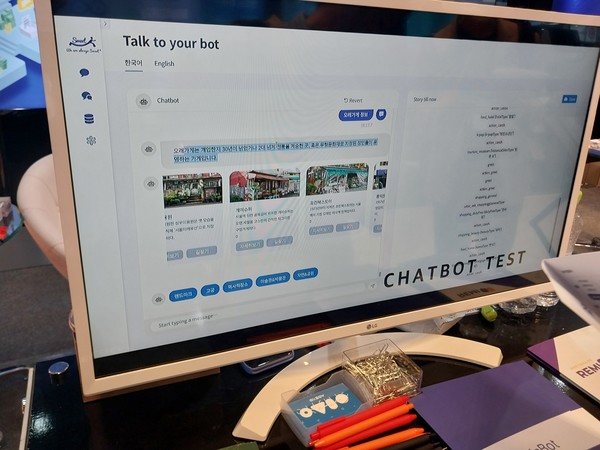

이는 우선 대화 내용을 요약할 수 있다. 이를 두고 “분명 이것 역시 하이퍼클로바로 생성했을 것”이란게 많은 개발자들의 추측이다.

또 요약한 문장을 장기기억 DB에 저장할 수 있다. 이때 모순되거나, 중복, 포함되는 등의 관계를 판단하여 추가하거나 삭제한다.

클로바 케어콜은 또 장기기억의 문장을 프롬프트로 함께 넣어서 질문 문장을 생성한다. 아직 그 기술이 공개되지 않다보니, 장기기억을 위해 특정 문장을 선택해서 그것만 입력하는지, 아니면 모든 장기기억을 한 번에 입력하는지를 두고 전문가들 사이에 의견이 엇갈린다.

그러나 “이 역시 하이퍼클로바를 바탕으로 현재 대화 맥락에 맞는 장기기억을 선택하는 과정 역시 하이퍼클로바이 있을 듯 하다”는 의견이 많다.

메타 Blenderbot2.0, 임베딩 방식으로 한계

메타에서 만든 Blenderbot2.0 역시 장기기억이 적용되고 있다. 이는 요약한 내용을 임베딩으로 저장해서 모델 연산에 바로 적용하는 방식을 구사한다. 이는 문장 자체를 저장하여 프롬프트에 한꺼번에 입력하는 네이버 클로바와는 대조적인 기법이다.

전문가들은 앞으로 이같은 장기기억 능력을 갖춘 챗봇 기술이 더욱 발달하면서 그 능력이 아예 필수적이 될 것으로 내다보고 있다. 이를 위해서는 역시 LLM을 바탕으로 할 수 밖에 없다.

만약 모델 크기가 작을 경우 메타의 ‘Blenderbot’처럼 모델링이 아닌 임베딩 방식으로 기억을 저장해야 한다. 그러나 현재 ‘Blenderbot’이 그렇듯이, 이런 방법은 유연성이 떨어지고 학습하기도 어렵다. 그래서 “모든 것을 초거대AI에 맡기는 것이 좀 더 편리할 것”이란게 많은 전문가들의 생각이다.

“큰 모델과 고비용 부담 각오해야 가능”

인공지능 챗봇 서비스를 개발하고 있는 메이팜(주)의 권 모 팀장은 “일상대화 AI는 기능형 AI보다 장기기억이 훨씬 더 중요하다. 나를 기억하지 못하면 관계가 형성될 수 없기 때문”이라고 강조했다.

이 회사도 장기적으로는 이런 기술을 고민하고 있다는 의미다. 그는 “다만 국내적으로 보면 기술적, 경제적인 문제가 있는데, 우선 모델의 성능이 좋아야 한다”고 했다.

그 역시 “저장된 문장과 현재 문맥을 잘 통합하여 대답하기 위해서는 큰 모델이 유리하다”면서 “문장을 요약하여 기록할 때 중복, 불일치, 통합, 삭제 등의 과정도 필요한데, 과연 얼마나 현재 대화와 유사한 기억을 가져오는가도 성능에 큰 영향을 준다”고 했다.

다만 프롬프트가 늘어나는 만큼 비용이 더 높아진다는 부담이 따른다. “그럼에도 불구하고, 장기기억이야 말로 일상대화 AI의 마지막 퍼즐”이라면서 “내년에는 이를 지원하는 서비스가 더 많아질 것”이라고 전망했다.