GPU, FPGA, ASIC, 뉴로모픽(Neuromophic) 반도체

‘GPU, 딥러닝 작업에 필요한 많은 연산을 빠르게 처리’

‘FPGA, 파이프라이닝으로 실시간 데이터 즉시 처리 최적화’

‘NPU, NNP, ANE 등, 인공 신경망 연산 특화된 프로세서들’

[애플경제 김향자 기자]인공지능 기술의 핵심인 AI반도체는 그 기능과 구조, 용도에 대한 다양한 분석이 이어지면서 이에 관한 대중적 인식도 높다. 그럼에도 이에 관한 명쾌하고 요약된 설명은 의외로 많지 않다. 그런 가운데 한국컴퓨팅산업협회에 따르면 AI 반도체는 아키텍처 구조에 따라, GPU, FPGA, ASIC, 뉴로모픽(Neuromophic) 반도체 등으로 분명하게 정의하고 있어 관심을 끈다.

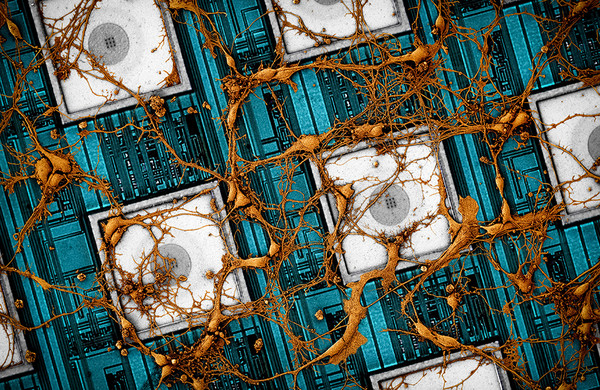

AI 반도체는 AI 기능을 구현하기 위해 데이터나 알고리즘을 효율적으로 처리할 수 있는 반도체다. 즉, 데이터를 동시에 병렬적으로 연산함으로써 동시 다발적인 학습과 추론이 가능하기 때문이다.

한국컴퓨팅산업협회, HPC이노베이션허브는 이에 대해 최근 ‘트렌드 리포트’를 통해 GPU, FPGA, ASIC, 뉴로모픽(Neuromophic) 반도체에 대한 명확한 설명을 통해 AI반도체의 실체를 좀더 분명히 하고 있다.

GPU, TPU…대규모 행렬 연산 초고속 병렬 처리

GPU는 대규모 행렬 연산을 병렬 처리하도록 설계된 고성능 그래픽 카드다. 현재 엔비디아(NVIDIA), 테슬라, AMD Radeon Instinct, Intel Xe 제품 등이 있다. 이들 제품은 대규모 병렬처리와 높은 데이터 처리 속도를 지원하는 역할을 한다.

또 구글이 개발한 ASIC(Application-Specific Integrated Circuit) 기반의 AI가속기로는 TPU가 대표적이다. 이는 구글 클라우드 플랫폼에서 제공하고 있다. 딥러닝 작업에 필요한 많은 수의 연산을 매우 빠르게 처리할 수 있도록 최적화한 것이다.

FPGA…사용자가 논리회로 프로그래밍

사용자가 프로그래밍하여 논리회로를 구성할 수 있는 하드웨어인 ‘FPGA’도 AI반도체의 주요 아키텍처다.

현재 Xilinx FPGA, Intel FPGA 제품이 출시되어 있다. 또 레터스 반도체(Lattice Semiconductor)사나, 마이크로세미(Microsemi), 퀵 로직(QuickLogic) 등의 FPGA 제조사에서 다양한 제품을 출시하고 있다. FPGA는 “소프트웨어와 하드웨어를 융합하여 하드웨어를 개발하는데 걸리는 시간과 비용을 줄일 수 있다”는 설명이다.

FPGA는 또 C 또는 C++ 언어 기반으로 작성된 프로그램을 파이프라이닝 기법 등을 통해 병렬 실행이 가능하다. 멀티 아키텍처를 지원하는 ‘OpenCL’, ‘SYCL’ 또는 ‘DPC++’(Intel oneAPI) 등을 활용하여 손쉽게 병렬 코드를 생성하고, 컴파일러 레벨에서 최적화된 바이너리를 생성할 수 있다.

이같은 FPGA의 파이프라이닝 병렬 방법을 사용하면 실시간으로 들어오는 데이터를 즉시 처리하도록 최적화하여 구성할 수 있다. 대용량 계산이 필요한 학습은 GPU를 활용하고, 실시간 처리가 필요한 추론은 FPGA를 활용하는 방식이 최근 많이 연구되고 있다. 일부 자동차 제조사에서도 FPGA를 장착한 차량을 개발하고 있다.

NPU, NNP, ANE 등 ‘뉴럴 아키텍처’

AI반도체의 또 다른 아키텍처는 NPU, NNP, ANE 등으로, 이는 인공 신경망 연산에 특화된 프로세서들이다.

주요 제품으로 인텔 네르바나(Intel Nervana) NNP, 화웨이 다빈치(Huawei Da Vinci) NPU, 애플 뉴럴 엔진, 퀄컴 AI 엔진, 삼성 뉴럴 프로세싱 유닛(NPU), 아마존 인퍼렌셜(Amazon inferential) 등 다양한 NPU 제품이 존재한다.

그 중 ▲‘인텔 네르바나(Intel Nervana) NNP’는 인공지능 처리를 위한 칩셋으로, 딥러닝 연산에 특화된 하드웨어다. 복잡한 딥러닝 모델의 효율적인 실행을 위해 메모리 처리를 최적화하고, 전체적인 에너지 효율을 향상시키는 기술을 적용한 제품이다.

딥러닝 모델의 학습 및 추론에 대한 지원을 제공하고, 인텔의 딥러닝 프레임워크와 통합하여 사용할 수 있다. 또 최적화 및 효율성 향상을 위한 소프트웨어 도구를 제공하고 있다.

▲애플 뉴럴 엔진(ANE)은 인공지능 전용 프로세서로서, 아이폰, 아이패드, 맥 등의 디바이스에서 작동하는 딥러닝 알고리즘을 효율적으로 실행하고 성능을 향상시키기 위해 설계된 것이다.

이는 기존의 CPU 및 GPU와는 다른 독립적인 프로세서로서, 독립적으로 동작하여 성능이 향상된다. 이미지 인식, 자연어 처리, 음성 인식, 추천 시스템 등 처리 등 다양한 인공지능 작업을 가능하게 한다.

또한 삼성 최신 스마트폰의 ▲‘AI 지우개’ 기능은 NPU 디바이스를 활용한 대표적 사례다. 이는 딥러닝 전용 하드웨어를 사용하므로 연산 처리 속도가 빠르고 전력 소모가 적다.